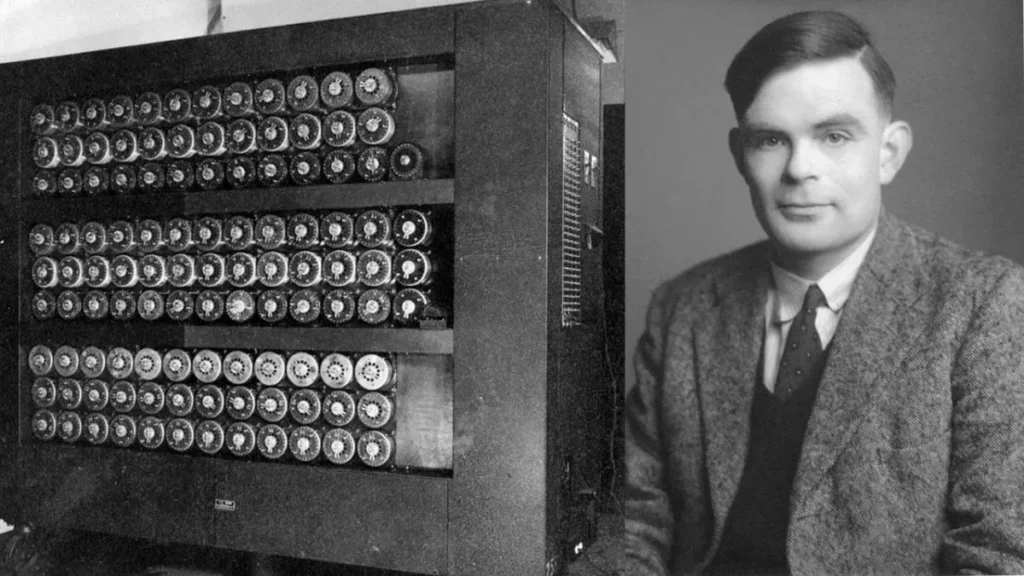

Nel 1950 Alan Turing fece una domanda apparentemente semplice: le macchine possono pensare? Settant’anni dopo quella domanda è ancora lì. Ed è ancora sbagliata.

Il problema non è trovare la risposta. È che la domanda è malposta.

Prima di chiedersi se le macchine pensino, bisogna capire cos’è il pensiero. E quando lo si fa davvero, molte delle certezze su cui si reggono le discussioni sull’IA cominciano a vacillare.

Il filosofo Dijkstra scrisse che chiedersi se le macchine possano pensare è tanto privo di senso quanto chiedersi se i sottomarini possano nuotare.

La reazione istintiva è: certo, i sottomarini non nuotano davvero.

Ma c’è una seconda lettura, molto più utile.

I sottomarini si muovono in tre dimensioni, raggiungono profondità impossibili agli esseri umani, sopportano pressioni che nessun nuotatore potrebbe tollerare. Non solo nuotano: in certi termini lo fanno meglio. La domanda non è se ci riescano. È se la categoria “nuoto” sia abbastanza grande per descrivere quello che fanno.

La stessa cosa vale per l’intelligenza artificiale.

Non “può pensare?”, ma: cosa potrebbe fare di ancora più interessante, oltre al pensiero?

Per rispondere, serve capire cosa fanno le menti.

Le menti costruiscono modelli. Rappresentazioni interne della realtà usate per guidare il comportamento. Questa definizione non esclude le macchine. Ma apre una distinzione più utile: tra sistemi capaci di costruire modelli globali e integrati, e sistemi che costruiscono solo modelli locali e isolati.

Per anni il grande limite dell’IA non era la velocità. Era l’incapacità di connettere le competenze tra loro. Deep Blue giocava a scacchi meglio di qualsiasi essere umano, ma non riusciva a collegare quella capacità a nulla nel mondo circostante. Era un’isola.

I grandi modelli linguistici sembrano aver ridotto quella distanza. Per la prima volta esistono sistemi in cui la conoscenza del linguaggio, della matematica, della storia, della fisica si connettono in un’unica struttura. Non sempre corretta. Ma integrata.

L’obiezione più comune è: “è solo statistica, solo moltiplicazioni di matrici.”

Questa critica si ritorce contro chi la usa.

I neuroni del cervello umano sono, a livello elementare, meccanismi elettrochimici relativamente semplici. Eppure da quella semplicità emerge la coscienza. La complessità del comportamento non viene dalla complessità degli elementi base, ma dall’organizzazione di quell’insieme.

Descrivere il meccanismo non significa spiegare il fenomeno.

Quello che resta aperto, e che nessuno ha ancora risolto, è la domanda sulla coscienza. Se esista qualcosa che “si prova” a elaborare un concetto, a costruire un modello interno del mondo.

Questo è il vero confine. Non tra intelligenza biologica e artificiale. Tra sistemi che elaborano e sistemi che, forse, in qualche modo ancora oscuro, sperimentano.

Che tipo di intelligenza stiamo costruendo? E soprattutto: per chi?

#IntelligenzaArtificiale #AI #TrasformazioneDigitale #MachineLearning #FuturoDelLavoro